当行业两大巨头英特尔与英伟达的技术在同一系统中协同工作,会擦出怎样的火花?在2025年OCP全球峰会上,英特尔交出了一份惊艳的答卷——通过将自家Gaudi3 AI加速器与英伟达B200 Tensor Core GPU相结合,打造出性能提升高达70%的异构AI系统。这一突破性进展不仅展现了异构计算在AI领域的巨大潜力,更预示着未来数据中心可能走向混合架构的新方向。

异构架构的强势组合

英特尔此次展示的高效异构AI系统采用了巧妙的资源分配策略。在这个混合计算基础设施中,英伟达B200 GPU负责AI模型的预填充阶段,而解码任务则由英特尔Gaudi3加速器接管。这种分工明确的架构设计让两种计算芯片各司其职,充分发挥各自的优势。

性能测试结果令人振奋:在运行Llama开源模型时,这套异构解决方案相比仅使用B200 GPU的同构系统,在总拥有成本(TCO)相同的情况下实现了至高70%的性能增益。这一显著提升证明了异构计算架构在处理复杂AI工作负载时的卓越效率。

高性能背后的技术支撑

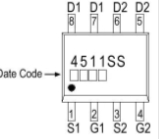

实现如此出色的性能表现,离不开先进的网络与互联技术支持。根据外媒SemiAnalysis的报道,该混合机架系统采用了多项尖端组件:英伟达ConnectX-7 400GbE NIC提供了超高速网络连接,BlueField-3 DPU负责数据处理加速,而博通的Tomahawk5 51.2Tb/s交换芯片则确保了系统内部的高速数据交换。

这些组件的协同工作极大地扩展了系统的处理能力和规模,为异构计算提供了强大的基础设施支持。特别是高速交换芯片的应用,有效解决了不同计算单元间数据传输的瓶颈问题,让Gaudi3和B200能够无缝协作。

异构计算的未来展望

英特尔这一创新尝试为AI计算架构的发展提供了新思路。传统上,企业往往需要在不同厂商的计算平台之间做出选择,而混合架构的出现打破了这一限制,让用户能够根据具体应用场景灵活组合最佳计算资源。

尤其值得注意的是,这套系统在保持高性能的同时还优化了总拥有成本,这对大规模部署AI应用的企业极具吸引力。随着AI模型复杂度不断提升,异构计算很可能成为平衡性能与成本的关键解决方案。

这次技术展示不仅体现了英特尔在AI计算领域的创新能力,也展示了行业协作的巨大价值。在AI算力需求爆发式增长的今天,这种打破界限的技术融合或许正预示着一个更加开放、协作的计算新时代的到来。

浙公网安备 33010502006866号

浙公网安备 33010502006866号